Jak ożywić zdjęcie z pomocą AI?

Każdy z nas ma takie zdjęcie. Czasem to babcia, która patrzy w obiektyw jakby coś chciała powiedzieć. Czasem dziadek w mundurze albo dziecko na szkolnym zdjęciu z lat 90. Zdjęcia, które coś znaczą. A co jeśli dałoby się tchnąć w nie odrobinę ruchu, gestu, emocji? Na tym polega „ożywianie” zdjęcia z pomocą AI – to proces, w którym statyczna fotografia zaczyna delikatnie się poruszać: twarz mruga, usta lekko się uśmiechają, głowa obraca się w subtelnym geście. W tym artykule pokażemy Ci, z jakich narzędzi skorzystać i jak to zrobić krok po kroku.

Najpierw przygotuj zdjęcie – popraw jego jakość w klasycznych narzędziach jak Fotor czy Canva. Dopiero potem wrzuć je do narzędzi typu PIXVERSE, KLING AI czy SadTalker, które zamienią je w krótkie wideo z ruchem i gestem. Wszystko masz opisane w dalszej części wpisu.

- Czym jest „ożywianie” zdjęcia i dlaczego ChatGPT tego nie zrobi?

- PIXVERSE i KLING AI - ożywianie zdjęć AI

- Inne ograniczenia, o których warto pamiętać

- Co jeszcze warto wypróbować i dlaczego warto się tym pobawić?

- Retusz i ożywianie zdjęć - jak to zrobić?

Czym jest „ożywianie” zdjęcia i dlaczego ChatGPT tego nie zrobi?

Kiedy mówimy o „ożywieniu” zdjęcia, chodzi o wygenerowanie krótkiej animacji na podstawie statycznego obrazu, w której np. twarz mruga, lekko się uśmiecha, kiwa głową lub wykonuje inny delikatny ruch. To nie deepfake – to kontrolowana animacja wybranych cech mimicznych.

Warto od razu powiedzieć wprost - ChatGPT – nawet w wersji Plus – NIE służy do tworzenia animacji ze zdjęcia. Może pomóc w przygotowaniu promptu, opisu lub analizy obrazu, ale samego wideo nie wygeneruje. Nawet SORA (dostępna w Plusie) nie sprawdza się dobrze w realistycznej animacji twarzy ze zdjęcia – generuje coś „podobnego”, ale bez osobistego efektu.

Dlatego potrzebujesz zewnętrznych narzędzi typu img2vid, które zamieniają obraz w klip. I tutaj wchodzą nasi bohaterowie: PIXVERSE i KLING AI.

PIXVERSE i KLING AI - ożywianie zdjęć AI

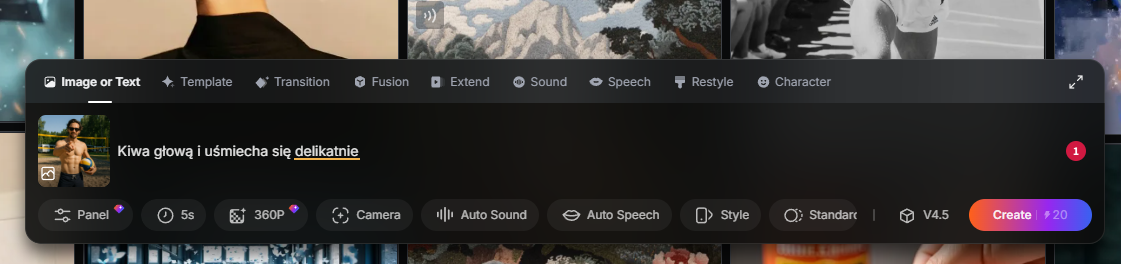

Jeśli dopiero zaczynasz i chcesz po prostu zobaczyć, jak wygląda poruszające się zdjęcie – PIXVERSE będzie dla Ciebie idealne. To narzędzie jest bajecznie proste – wrzucasz fotkę, wpisujesz krótki opis i za chwilę masz gotowy 5-sekundowy klip.

Jest jeden haczyk. W darmowym planie dostajesz tylko dwie animacje dziennie. I to w dość niskiej rozdzielczości (360p), więc nie licz na kinowe doznania. Nie można też wybrać długości klipu – po prostu dostajesz domyślny preset. Ale w zamian masz szybko, bez logowania i praktycznie bez ryzyka.

Jak to działa:

- Wchodzisz na stronę PIXVERSE.

- Wgrywasz zdjęcie (najlepiej portret, twarz na wprost, dobrze oświetlona).

- Wpisujesz prompt – np. „Kiwa głową i uśmiecha się delikatnie”.

- Wybierasz długość animacji (zazwyczaj 5 sekund).

- Klikasz „Generate” – i gotowe.

To rozwiązanie jest świetne dla tych, którzy:

- Chcą szybkiego efektu bez zabawy w ustawienia.

- Nie potrzebują dużej rozdzielczości.

- Dopiero testują, jak „zachowa się” ich zdjęcie w AI.

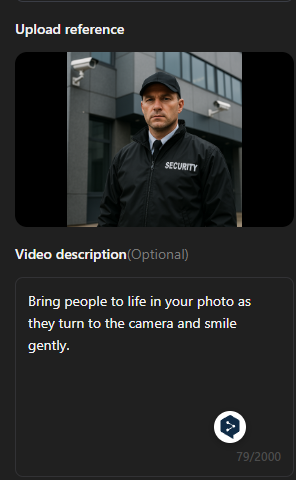

KLING AI z kolei jest dla tych, którzy chcą więcej kontroli. KLING to półprofesjonalne studio AI w przeglądarce, które pozwala na szczegółowe dopasowanie animacji, stylu ruchu, długości i ekspresji. Każdy użytkownik darmowy dostaje 166 kredytów miesięcznie, a jedno 5-sekundowe wideo kosztuje 20 kredytów. Co oznacza, że w miesiącu wygenerujesz max 8 klipów. Chyba że dokupisz pakiet.

Czas generowania? Różnie. Raz to 5 minut, raz czekasz kwadrans – zależy od obciążenia serwera i złożoności promptu. Jak dasz mu za dużo „wyobraźni” albo zrobisz zbyt dynamiczny opis, AI może przerysować twarz albo zgubić podobieństwo do oryginału. Autorzy filmów radzą wtedy: zmniejsz „imagination level”, skróć prompt, unikaj przesady.

Co możesz ustawić:

- Rodzaj ruchu (np. głowa w lewo/prawo, uśmiech, mrugnięcie).

- Czas trwania (np. 5 lub 10 sekund).

- Poziom „wyobraźni” AI (czyli jak bardzo może sobie „dopowiedzieć” brakujące dane).

- Styl (bardziej realistyczny vs kreatywny).

- Możliwość dogrania audio + funkcja lip-sync (ruch ust do dźwięku).

Proces ożywiania zdjęć:

- Tworzysz konto (darmowe 166 kredytów/miesiąc).

- Wgrywasz zdjęcie i opisujesz, co ma robić postać.

- Ustawiasz parametry: ruch, długość, styl.

- Generujesz – zwykle trwa to od 5 do 10 minut.

- Pobierasz gotowy klip.

Wady? Zdarza się, że AI „przerysuje” emocje, a uśmiech wygląda nienaturalnie. Ale to można skorygować, zmniejszając wyobraźnię AI lub skracając ruch.

Inne ograniczenia, o których warto pamiętać

Nie wszystkie narzędzia są równe. Jedne pozwalają na więcej, inne mają swoje „ale”. Na przykład:

- Nie każde zdjęcie da się dobrze ożywić – najlepiej działa twarz na wprost, dobrze oświetlona, bez zakryć i filtrów.

- Jeśli AI doda dziwny uśmiech albo zniekształcenie, to znak, że coś poszło za daleko. Trzeba cofnąć się do promptu lub zmniejszyć kreatywność modelu.

- W darmowych wersjach może pojawić się watermark – często da się go uniknąć, pobierając wideo zanim zakończy się generowanie.

- Brak audio i lip-sync – to funkcje dostępne tylko w wybranych narzędziach, np. GANZEN AI, który też ma limit punktów, ale można go „obchodzić” (np. przez tymczasowy mail).

- Nie używaj tych narzędzi komercyjnie bez licencji – darmowe plany są do użytku prywatnego, czyli dla siebie, rodziny, znajomych.

Co jeszcze warto wypróbować i dlaczego warto się tym pobawić?

No właśnie. Wspomnieliśmy o kilku ograniczeniach, ale przecież są też inne narzędzia AI, które można wypróbować i albo zmienić podejście do generowania filmów z obrazu, albo całkowicie zmienić koncepcję. Poza PIXVERSE i KLING AI, które są absolutnymi faworytami w temacie portretów i ruchów twarzy, istnieje cały zestaw darmowych lub półdarmowych narzędzi, które pozwalają ożywić zdjęcie w mniej typowy sposób: jako scenę 3D, głos mówiący, rysunek w ruchu czy wręcz... mini film AI.

Niektóre z tych narzędzi są zaskakująco dobre, inne bardziej „dla zabawy”, ale prawda jest taka: każde z nich ma swój moment i zastosowanie. Oto kilka z nich, które naprawdę warto wypróbować:

Lupix + Illumin AI

Zaczyna się niewinnie: wrzucasz zdjęcie do Lupix, a ono robi z niego „głębiowy” efekt ruchu. Ale to nie koniec – eksportujesz depth mapę i przenosisz ją do Illumin AI, gdzie zamieniasz płaską fotografię w interaktywną przestrzeń 3D, po której możesz się poruszać.

Efekt? Zdjęcie nagle staje się jak scena z gry albo ujęcie z trailera. Masz tło, głębię i ruch kamery. Świetna rzecz do teaserów, reelsów, intro do vloga.

SadTalker – zdjęcie, które mówi Twoim głosem

Jeśli masz zdjęcie osoby i nagranie głosu (np. babcia opowiadająca bajkę), SadTalker z Hugging Face potrafi to połączyć.

To najlepsza w pełni darmowa opcja do animacji ust zsynchronizowanych z dźwiękiem. Trochę techniczna (są suwaki, modele twarzy, ekspresja), ale jak już wgrasz audio i dobrze ustawisz proporcje – efekt potrafi być poruszający. Minus? Generowanie może trwać długo, ale warto poczekać.

Genmo – poklikaj i pogadaj z obrazem

To narzędzie ma wbudowanego chatbota – po prostu wrzucasz zdjęcie i piszesz do niego, co ma się dziać.

- „Zamruga oczami”, „poruszy trąbą” (jeśli to słoń) – brzmi zabawnie? No właśnie!

Możesz zmieniać dynamikę, długość, styl – a do tego wszystko jest intuicyjne, wręcz zabawowe. To taki „piaskownicowy playground AI”, ale z realnym potencjałem. Darmowy plan odnawia się codziennie (100 punktów dziennie), więc świetne do codziennych testów.

Meta Animator – rysunki dzieci w ruchu (lub dziwaczne memy)

To narzędzie stworzone z myślą o animowaniu dziecięcych rysunków – ale możesz je „oszukać”, wrzucając tam postać narysowaną w Midjourney lub prostą sylwetkę z białym tłem. Wyznaczasz punkty stawów, a system sam tworzy kilkanaście zabawnych ruchów i gestów. Efekty bywają… nieprzewidywalne, ale czasem wręcz rewelacyjnie śmieszne

---

Retusz i ożywianie zdjęć - jak to zrobić?

Zanim wrzucisz swoje stare zdjęcie do KLING, PIXVERSE czy czegokolwiek z AI-video, warto najpierw je poprawić. I mówiąc poprawić, mamy na myśli cyfrowy retusz – bo jeśli fotka jest rozmazana, porysowana albo wyblakła jak wspomnienie z kasety VHS, to nawet najlepsze AI nie wyczaruje z niej ruchu, który ma sens.

Owszem — jeśli korzystasz z wersji z funkcją obrazu, to ChatGPT potrafi „naprawić” zdjęcie. Ale nie traktuj tego jak klasyczny retusz czy korektę detali. To nie jest Photoshop. To jest model generatywny, więc jego podejście do „naprawy” to po prostu stworzenie nowej wersji zdjęcia, inspirowanej oryginałem. To może wyglądać świetnie, być ostrzejsze, bardziej kolorowe, realistyczne. Ale może też nie wyglądać jak osoba ze zdjęcia. Twarz może się subtelnie zmienić. Mimika, proporcje, nawet spojrzenie – wszystko zależy od tego, co model „zrozumie” z obrazu.

Więc jeżeli masz jedno jedyne zdjęcie babci, dziadka czy kogoś ważnego, i chcesz, by animacja zachowała ich rysy – lepiej zrobić retusz w klasycznym edytorze (np. Fotor, Canva), a nie regenerację AI (chociaż AI ułatwia wszystko).

- Zajrzyj na Fotor – ma funkcję wyostrzania, kolorowania i usuwania uszkodzeń.

- Albo do Canva – niby prosty edytor, ale z AI do naprawiania fotek działa zaskakująco dobrze.

- Możesz też spróbować Design.ai – ale pamiętaj, że czasem obraz wyjdzie „zainspirowany” oryginałem, a nie jego wierną kopią.

I tu ważne: nie zdziw się, że po retuszu twarz może wyglądać nieco inaczej. To jest AI, a nie chirurg plastyczny z pamięcią emocjonalną. Potraktuj to jako bazę — nie rekonstrukcję historyczną.

Dopiero po takim czyszczeniu możesz wrzucać obraz do KLING, PIXVERSE, SORA czy nawet SadTalker — i dopiero wtedy zaczyna się ustalanie ruchu, mrugnięcia, gestu.

.